- 国内站

- 国际站

无数据

摘要 (Abstract) 是一篇学术论文的灵魂。它高度浓缩了您的研究背景、核心方法、实验数据与最终结论。 在写完正文后,很多作者为了省事,习惯把全文扔进大语言模型里,下达指令:“请帮我提炼一段 200 字的英文摘要。”

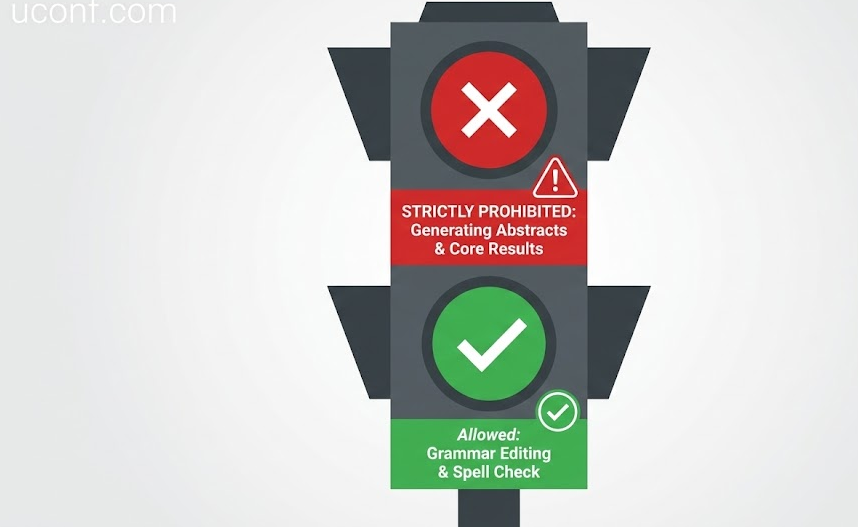

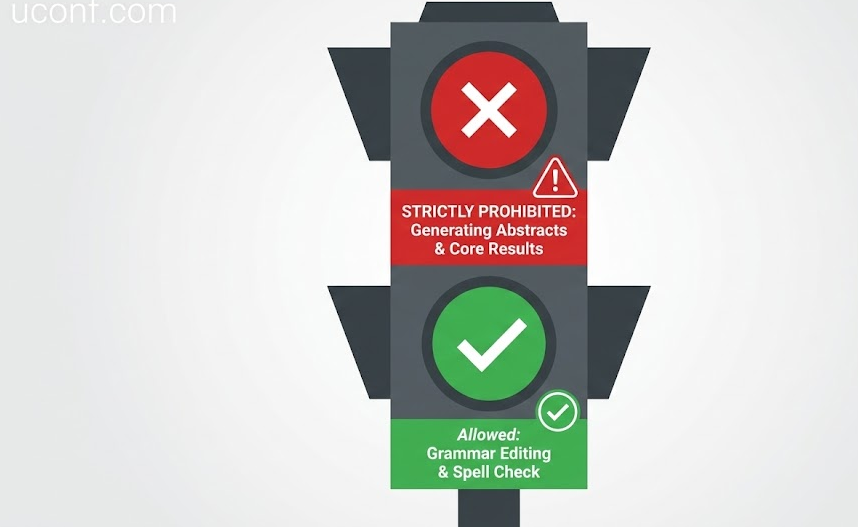

在 2026 年的学术出版界,这个看似极具效率的操作,正面临着前所未有的合规风险。许多国际顶尖学术机构已经明确表态:使用 AI 进行语言润色可以,但直接使用 AI“生成”代表核心学术贡献的摘要,属于严重违规。

本文为您梳理哪些重磅学术平台明确对“AI 生成摘要”下达了禁令,并教您如何安全合规地完成论文的收尾工作。

如果您计划向所在领域的“天花板”级别平台投稿,请立刻停止让 AI 帮您写摘要的念头。

作为全球最具影响力的学术出版机构之一,《Science》(科学) 杂志及其附属平台曾发布过极其严厉的声明:完全禁止在论文中使用 AI 生成的文本(包括摘要)、图像或图形。 官方的逻辑非常清晰:AI 无法对其生成的错误数据承担法律与科研伦理责任。摘要包含了论文最核心的科学发现,必须由人类作者逐字斟酌、独立撰写。一旦在审查或后续同行评审中发现摘要存在 AI 生成的幻觉 (Hallucination) 或高相似度,将面临直接撤稿。

在人工智能研究的最前沿(如早期的 ICML 等会议),组委会曾针对利用大型语言模型生成论文文本发布过严格禁令。 经过政策的不断迭代,目前 2026 年的普遍共识是:严禁使用 AI 工具生成构成论文“主要科学贡献”的文本。 由于摘要是对主要科学贡献的直接陈述,如果您的摘要是 100% 由 ChatGPT 提炼生成的,这在技术审查阶段将面临极高的道德风险,极易被判定为学术不端。

对于大多数常规的国际学术会议(如由 IEEE、ACM 或 Springer 出版的会议论文集),政策相对温和,但同样布满了高压线。

这些出版巨头的核心原则是:AI 不能作为作者署名,且必须明确披露生成内容。

语言润色是合法的:如果您自己用中文或蹩脚的英文写好了摘要的初稿,然后使用工具让它变得符合学术英语规范,这是完全允许的,无需声明。

直接生成摘要极其危险:如果您没有初稿,而是让 AI 通过提取正文的关键词直接“无中生有”拼凑出一段摘要,这属于“实质性内容生成”。按照规定,您必须在致谢 (Acknowledgments) 中详细说明 AI 的介入程度。然而,绝大多数审稿人在看到“摘要由 AI 生成”的声明时,会立刻对该论文的原创性产生严重怀疑,导致极高的拒稿率。

为了确保您的心血之作不被 AI 检测工具(如 Turnitin 的 AI Score 模块)误伤,请坚持以下“人工主导,机器辅助”的原则:

坚持人工撰写摘要骨架: 请亲自写下摘要的四要素(目的、方法、结果、结论)。即使您的英语句式很简单,也要确保核心逻辑和具体数据是您亲手键入的。

使用限制性提示词 (Prompt) 进行润色: 不要向工具发送“帮我写摘要”的指令。正确的指令应当是:“以下是我撰写的论文摘要初稿,请在不改变任何原意、不增加任何新信息的前提下,帮我修正语法错误,并提升学术表达的专业度。”

核对每一处关键数据: 大模型在润色时,极易对数字或专有名词进行错误的“优化”。润色完成后,务必人工核对摘要中的实验数值是否与正文图表完全一致。

摘要 (Abstract) 是一篇学术论文的灵魂。它高度浓缩了您的研究背景、核心方法、实验数据与最终结论。 在写完正文后,很多作者为了省事,习惯把全文扔进大语言模型里,下达指令:“请帮我提炼一段 200 字的英文摘要。”

在 2026 年的学术出版界,这个看似极具效率的操作,正面临着前所未有的合规风险。许多国际顶尖学术机构已经明确表态:使用 AI 进行语言润色可以,但直接使用 AI“生成”代表核心学术贡献的摘要,属于严重违规。

本文为您梳理哪些重磅学术平台明确对“AI 生成摘要”下达了禁令,并教您如何安全合规地完成论文的收尾工作。

如果您计划向所在领域的“天花板”级别平台投稿,请立刻停止让 AI 帮您写摘要的念头。

作为全球最具影响力的学术出版机构之一,《Science》(科学) 杂志及其附属平台曾发布过极其严厉的声明:完全禁止在论文中使用 AI 生成的文本(包括摘要)、图像或图形。 官方的逻辑非常清晰:AI 无法对其生成的错误数据承担法律与科研伦理责任。摘要包含了论文最核心的科学发现,必须由人类作者逐字斟酌、独立撰写。一旦在审查或后续同行评审中发现摘要存在 AI 生成的幻觉 (Hallucination) 或高相似度,将面临直接撤稿。

在人工智能研究的最前沿(如早期的 ICML 等会议),组委会曾针对利用大型语言模型生成论文文本发布过严格禁令。 经过政策的不断迭代,目前 2026 年的普遍共识是:严禁使用 AI 工具生成构成论文“主要科学贡献”的文本。 由于摘要是对主要科学贡献的直接陈述,如果您的摘要是 100% 由 ChatGPT 提炼生成的,这在技术审查阶段将面临极高的道德风险,极易被判定为学术不端。

对于大多数常规的国际学术会议(如由 IEEE、ACM 或 Springer 出版的会议论文集),政策相对温和,但同样布满了高压线。

这些出版巨头的核心原则是:AI 不能作为作者署名,且必须明确披露生成内容。

语言润色是合法的:如果您自己用中文或蹩脚的英文写好了摘要的初稿,然后使用工具让它变得符合学术英语规范,这是完全允许的,无需声明。

直接生成摘要极其危险:如果您没有初稿,而是让 AI 通过提取正文的关键词直接“无中生有”拼凑出一段摘要,这属于“实质性内容生成”。按照规定,您必须在致谢 (Acknowledgments) 中详细说明 AI 的介入程度。然而,绝大多数审稿人在看到“摘要由 AI 生成”的声明时,会立刻对该论文的原创性产生严重怀疑,导致极高的拒稿率。

为了确保您的心血之作不被 AI 检测工具(如 Turnitin 的 AI Score 模块)误伤,请坚持以下“人工主导,机器辅助”的原则:

坚持人工撰写摘要骨架: 请亲自写下摘要的四要素(目的、方法、结果、结论)。即使您的英语句式很简单,也要确保核心逻辑和具体数据是您亲手键入的。

使用限制性提示词 (Prompt) 进行润色: 不要向工具发送“帮我写摘要”的指令。正确的指令应当是:“以下是我撰写的论文摘要初稿,请在不改变任何原意、不增加任何新信息的前提下,帮我修正语法错误,并提升学术表达的专业度。”

核对每一处关键数据: 大模型在润色时,极易对数字或专有名词进行错误的“优化”。润色完成后,务必人工核对摘要中的实验数值是否与正文图表完全一致。